天啊,你是不是也遇到过这种情况——费尽心思训练出来的AI模型,表现却总是差强人意,反应迟钝、理解偏差,甚至时不时冒出些让人啼笑皆非的答案?别急着怀疑算法,问题很可能出在更源头的地方:你喂给AI的“食物”——AI训练数据——可能已经变质了!

你知道吗,数据质量每提升10%,模型的准确率平均能提升6%-12%-9。这比你盲目增加算力、堆叠网络层数要高效经济得多!但现实中,多少企业手握海量数据宝藏,却因为不会整理、不会“烹饪”,最终只能眼巴巴看着AI项目烂尾。

AI的“挑食”本性:它比你想象的更难伺候

咱们得先搞清楚,AI模型可不是垃圾桶,不是什么数据都能往里扔。低质量的AI训练数据就像垃圾食品,短期看似乎填饱了肚子,长期下来只会导致模型“营养不良”甚至“中毒”-6。

那些未经清洗的数据里藏着多少坑?标签错误百出、样本分布极度不均、噪声干扰严重……更别提数据孤岛让不同系统的数据老死不相往来。你指望用这样的数据训练出一个聪明伶俐的AI?简直就像用混乱的教材教出学霸一样不切实际!

记得有个做金融风控的朋友跟我吐槽,他们初期用的交易数据时间格式五花八门,有的用“2023/12/01”,有的用“2023-12-01”,还有的用“01Dec2023”。结果模型在处理时间序列时彻底混乱,预测效果一塌糊涂。看,这就是数据不一致性带来的灾难!

数据厨房的必备工序:从粗粮到精粮的蜕变

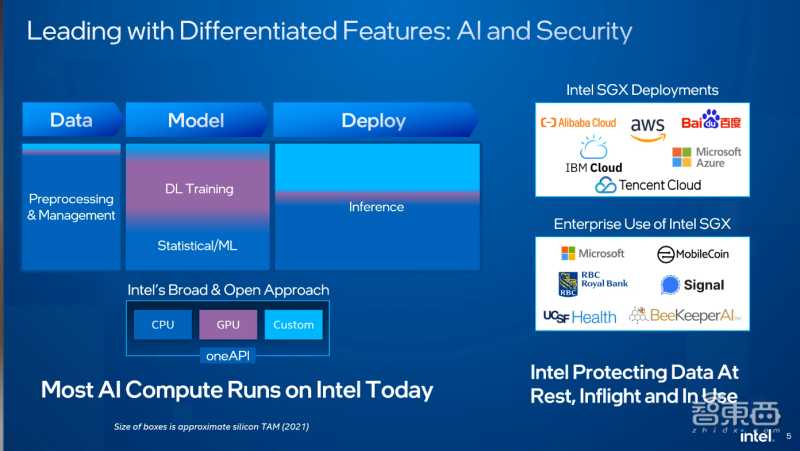

想把原始数据变成AI爱吃的高品质“营养餐”,你得有一套标准化的“烹饪流程”。华为云ModelArts Studio把这事儿分解得挺明白:数据获取、加工、合成、标注、配比、评估、发布,一环扣一环-1。

数据清洗这关特别关键。想象一下你在准备高级料理,能不仔细剔除食材中的杂质吗?同样的道理,对于文本数据,你需要剔除乱码、纠正拼写错误、统一格式;对于图像数据,则要调整尺寸、标准化色彩、去除噪声。现在有些智能平台已经能自动化完成大部分清洗工作,比如自动识别并修复常见的数据问题-1。

而数据标注更是重头戏。以前全靠人工,费时费力还容易出错;现在有了AI辅助标注,系统可以预先给出标注建议,人工只需审核修正,效率提升不是一星半点-1。不过这里有个窍门——多人标注加审核机制能显著提升标注质量,防止因个人主观判断导致的偏差。

小心“合成数据”的甜蜜陷阱

数据不够怎么办?很多人第一个想到的就是用合成数据来凑。但这招用不好就是饮鸩止渴!

最新研究敲响了警钟:合成数据如果用得不好,可能导致“模型崩溃”-6。即使只进行一次训练,如果混入较高比例的合成数据,模型性能也会急剧下降,难以泛化到真实世界。为什么会这样?因为合成数据往往缺乏真实数据中的多样性和长尾样本,表达结构也容易趋同-6。

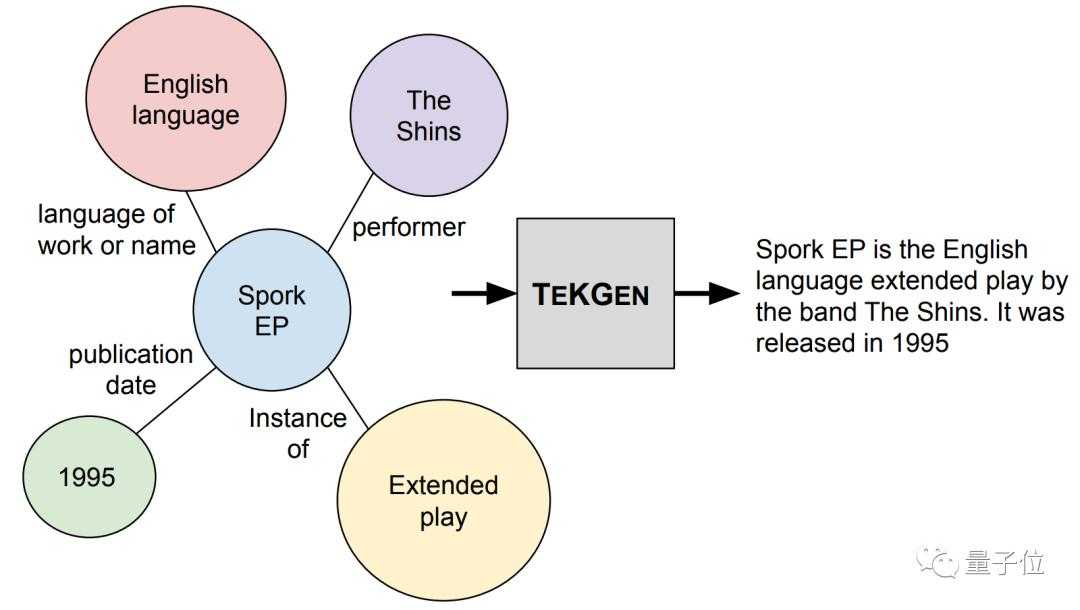

不过也别因噎废食,聪明的做法已经出现了。北京通用人工智能研究院提出的“Token-Level Editing”方法就很有创意——不直接合成整段文本,而是在真实数据上做精细化的token级别替换-6。简单说,就是找到那些模型“过于自信”的词语,用同义词或相关词替换,既增加了多样性,又保持了真实数据的自然分布。

给数据加点“人性化”调味料

想让你的AI产出更自然、更难被检测出是机器生成的内容?那你得在数据里加点“人性化”的调味料。

方言引用是个妙招。中国地大物博,方言差异巨大,同样的词语在不同地区可能有完全不同的发音和含义。适当地在训练数据中加入方言元素,不仅能提升模型的语言理解广度,还能让输出更具地方特色和亲和力-8。比如粤语中的“乜嘢”(什么)、“佢”(他/她),这些方言词汇的加入能让AI更懂广东用户的表达习惯。

伪错误的巧妙运用也很有意思。完全标准化的语言反而不像真人所说。真人的表达会有细微的不流畅、偶然的用词不当、甚至故意的口语化省略。在整理训练数据时,可以适度保留或添加这些“不完美”,让模型学会理解和生成更接近人类自然交流的内容。

别忘了情绪化表达的力量!人们在真实交流中会使用感叹词、语气助词、情感强烈的形容词。相比冷冰冰的陈述句,“这个方案简直太棒了!”和“这个方案不错”传达的信息相同,但情感色彩天差地别。训练数据中如果缺少这种情绪层次,训练出的AI就会像个情感障碍者,永远用平淡无波的语调说着一切-2。

实战心法:数据整理中的避坑指南

说了这么多理论,最后分享几个实操中的黄金法则:

比例配比要科学。不同来源、不同类型的数据要有合理配比-1。就像营养餐要讲究荤素搭配,训练数据也要平衡多样性与代表性。一般来说,核心场景的数据应该占较大比例,边缘案例也要适量包含,这样才能训练出既专业又灵活的模型。

持续迭代是关键。数据整理不是一劳永逸的事情。模型在应用中暴露出的问题,要能反馈到数据整理环节,形成闭环优化-7。比如发现模型在某些特定情况下表现不佳,就要针对性补充相关数据,然后重新训练。

工具选型很重要。现在市面上有不少数据整理平台,如华为云的ModelArts Studio、紫光云的数据平台等,都提供了从数据归集到加工的全套工具链-1-4。选择合适的工具能事半功倍,尤其是在处理大规模数据时,自动化工具的优势更加明显。

质量评估不可少。数据整理完后,一定要有严格的评估环节-1。不仅要看表面的一致性、完整性,更要关注数据是否真实反映了业务场景,分布是否合理,是否存在潜在偏见。评估时最好结合自动指标和人工审核,双管齐下确保数据质量。

说到底,整理AI训练数据就像为一位挑剔的美食家准备盛宴,需要耐心、细心和匠心。每一份高质量的数据,都是未来AI模型聪明表现的基石。别再让你的AI宝宝饿肚子或者吃坏肚子了,从现在开始,重视数据整理,喂出更健康、更聪明的AI模型!

当你看到训练出的AI模型终于能准确理解复杂问题、给出人性化回答时,你会明白,所有在数据整理上的投入都是值得的。毕竟,养一个聪明的AI宝宝,不比养一个人类宝宝容易多少,不是吗?