一文读懂大数据概念、处理方法和流行技术

你是否好奇,每天产生的海量数据如何被转化为商业洞察?在数据爆炸的时代,理解并高效处理大数据已成为企业和研究者的决胜关键。本文将带你从基础特性出发,深入解读分而治之的思想,并揭秘流行的大数据技术,助你快速掌握概念、方法与实战工具。作者:皮皮鲁的AI星球

什么是大数据?

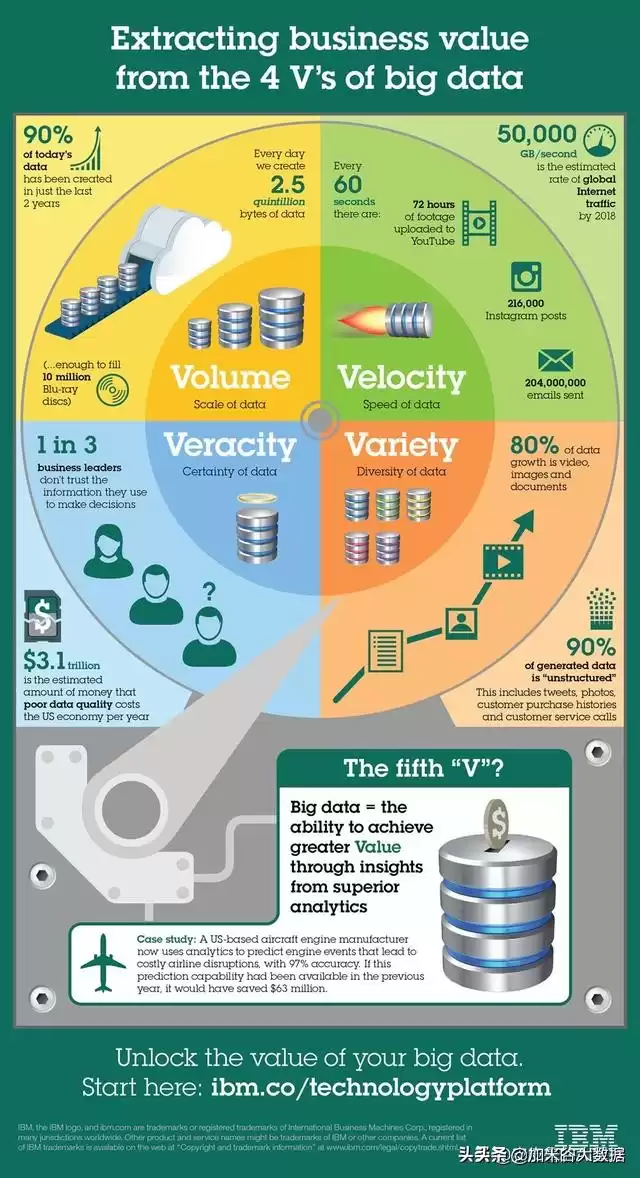

大数据,顾名思义,就是规模庞大的数据集合。但它的定义远不止于此——不同领域的人可能有不同理解。IBM将其核心归纳为5个V,覆盖了大数据绝大多数关键特性。

大数据的5个V

Volume:数据体量巨大,从TB、PB到ZB甚至YB级别。例如,纽约证交所日交易数据达TB级,大型强子对撞机年数据约PB级,而全球数据总量已进入ZB时代。更大规模的数据让我们能全面洞察研究对象的历史、现状与未来。Velocity:数据生成极快,处理速度要求高,因为时间就是金钱。金融市场需秒级处理交易数据,搜索推荐引擎需分钟级推送新闻。更快处理速度支持更实时决策。Variety:数据类型多样,包括数字、文本、图像、视频等结构化与非结构化数据,源自社交网络、传感器等多种源头。Veracity:数据真实性。数据常掺杂异常值,如统计偏差或人为影响,且多元异构数据需清洗整合,形成高置信度信息,这极具挑战。Value:数据价值。最终目标是通过前四个V挖掘深层价值,为决策提供强大支持。

在数据分析中,总体指研究对象全部数据,常因无限或庞大而无法全部分析。样本是总体的子集,通过分析样本来推断总体。例如,调查各国国民诚信度时,可抽取样本代表总体。

大数据技术兴起前,受限于存储与分析能力,研究者只能使用小样本。如今,技术突破让大规模高速分析成为可能。但数据并非天然有价值——如何点石成金仍是挑战。在诚信调查中,直接询问可能得不到真实答案,但结合工作经历、征信等多渠道数据,便能更准确评估。

可见,大数据以更大体量、更快速度、更多类型为特点,在真实性基础上,最终服务于价值挖掘。

随着技术演进,数据复杂性提升,5V之外出现了新补充:如动态性(Vitality)强调体系活力;可视性(Visualization)突出数据展现;合法性(Validity)关注隐私合规;数据在线(Online)确保随时可调用。

分布式计算 分而治之

传统单机计算难以应对大数据需求。于是,集群计算崛起——将多台计算机组织起来,用分布式处理海量数据,这已成为主流方案。所有现代大数据系统都基于集群的分布式计算。

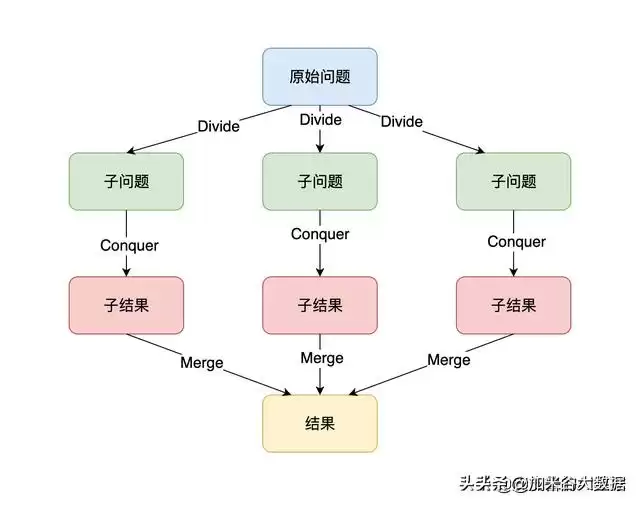

分而治之的算法思想

分布式计算听起来高深,但思想朴素:即分而治之(Divide and Conquer)。它将原始问题拆解为子问题,在多台机器(节点)上并行求解,通过数据交换与合并策略汇总结果。具体算法因问题而异,但核心都是拆分计算、分布处理。

科研界已有成熟分布式方案,如消息传递接口(MPI)和MapReduce。

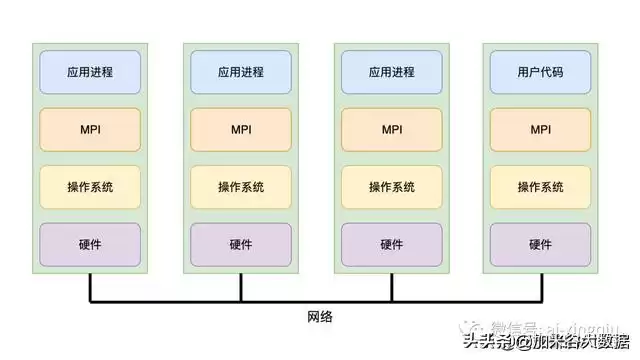

MPI

MPI是老牌框架,专注节点间数据通信。在前MapReduce时代,它是分布式计算标准,至今仍广泛用于超级计算中心和研究机构,支撑物理、生物等基础学科的大规模计算。

分治法将问题切分后在不同节点求解,MPI提供了多进程数据通信方案,便于中间计算与最终合并时的数据交换同步。

MPI并行计算示意图

MPI的核心操作是数据发送(Send)和接收(Recv)。上图展示了4台服务器上的并行计算:程序员需手动设计分治算法,调用MPI库发送数据给指定进程。

MPI的优势是细粒度控制,可优化性能;但劣势也是控制过细——从算法设计到通信汇总都需手动编程,调试成本高,节点失败易导致全盘崩溃,对多数程序员来说门槛极高。

就像C语言快但Python更受欢迎一样,MPI虽快却不够接地气,学习与开发时间成本巨大。

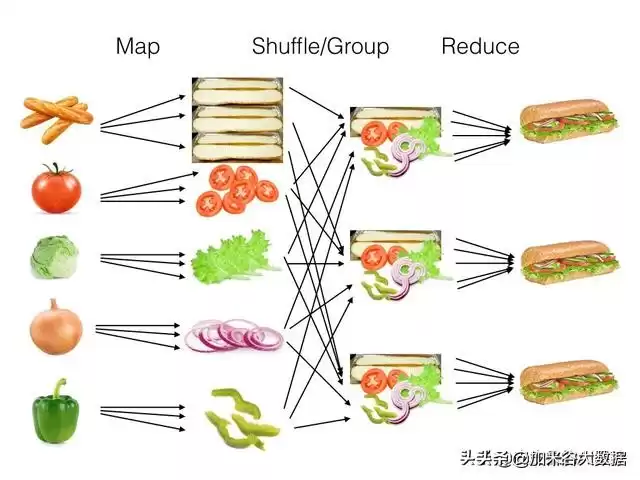

MapReduce

为降低分布式计算门槛,研究人员提出了更易用的MapReduce编程模型。Google于2004年推出这一范式,它只需程序员定义map和reduce两个操作,简化了流程。

使用MapReduce制作三明治

这里用三明治制作为例:map阶段在不同节点处理原材料生成中间食材,shuffle阶段组合中间食材,reduce阶段最终成品。这种map + shuffle + reduce方式正是分而治之的实现。

基于MapReduce模型,团队开发了多种大数据框架:Hadoop是开源先驱,成为业界标杆;随后Spark和Flink涌现。这些框架提供API,帮助程序员存储、处理和分析大数据。

相比MPI,MapReduce封装了更多中间过程,程序员只需用高阶API转化问题,细节交由框架处理,因而学习门槛低、开发更快。

批处理和流处理数据与数据流

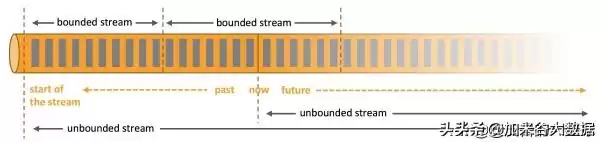

从时间维度看,数据源源不断产生,形成无界数据流。例如,手机传感器持续累积运动数据,金融交易实时发生。数据流中的有界段可组成数据集。通常的数据分析针对数据集,但随着数据加速生成,处理数据流越来越受关注。

数据与数据流

批处理

批处理是对一批数据进行计算。常见场景如:微信运动每晚统计好友步数排名,银行每月生成信用卡账单,国家统计局季度GDP统计。这些任务聚合一段时间的数据,当数据量庞大时计算耗时。

批处理历史悠久,当前广泛应用于数据仓库ETL工作,如Oracle商业仓库和Hadoop/Spark开源方案。

流处理

流处理直接对数据流进行操作。在金融、电商等领域,实时性意味着巨大价值:双十一管理者需秒级查看销售业绩,股票交易以毫秒级响应新信息,风控系统快速拦截欺诈,网络运营商即时发现故障。响应越快,损失越少、收入越高。随着IoT和5G爆发,更海量的实时数据将涌来,流处理需求必然激增。

代表性大数据技术

MapReduce模型开创先河后,Hadoop、Spark和Flink等框架相继崛起。

Hadoop

2004年,Hadoop创始人受MapReduce论文启发,实现了这一框架。名字源自玩具大象,因创始人加入雅虎并获支持,常被视为雅虎开源成果。如今,Hadoop不仅是领域先驱,更形成了完整生态系统,成为企业首选方案。

零基础班大数据工程师培训,数据分析、数据挖掘,大数据开发,加米谷大数据培训机构

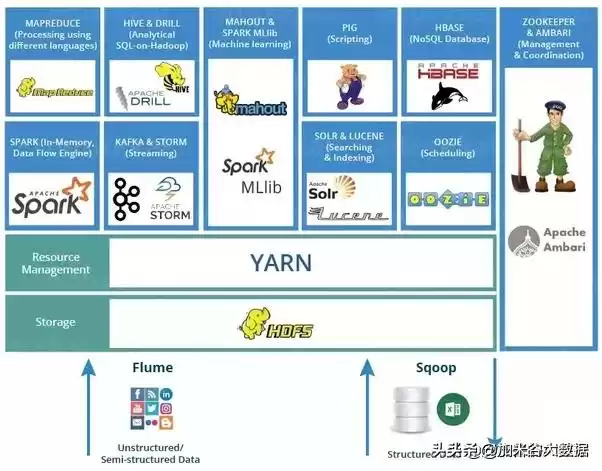

Hadoop生态

Hadoop生态组件丰富,核心有三:

Hadoop MapReduce:处理海量数据,面向批处理。HDFS:分布式文件系统,扩展性与容错性出色。YARN:资源调度器,管理集群并分配计算资源。

数据存于HDFS,由MapReduce计算,YARN管理资源。其他著名组件包括:

Hive:用SQL查询HDFS结构化数据,SQL转为MapReduce执行。HBase:基于HDFS的分布式数据库,提供毫秒级实时查询。Storm:实时计算框架,专攻流处理。Zookeeper:分布式协调者,管理生态组件。Spark

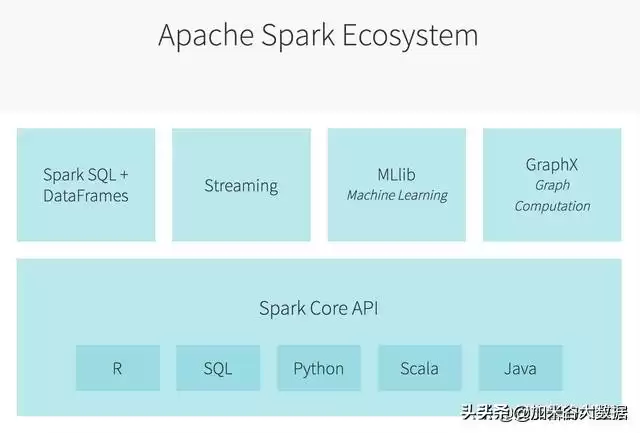

Spark诞生于2009年伯克利分校,2013年捐给Apache。它旨在改良Hadoop MapReduce的模型与速度,主要改进在两点:

易用性:提供更友好接口,支持Java、Scala、Python和R的API,涵盖SQL、机器学习和图计算,覆盖多数场景。速度快:将中间结果放入内存,优化有向无环图,比Hadoop快百倍以上。

Spark生态

Spark核心在计算,优化Hadoop的计算层面,提供细致服务。它并非取代Hadoop,而是融入其生态,常与HDFS、YARN等协作。当然,它也能独立运行。

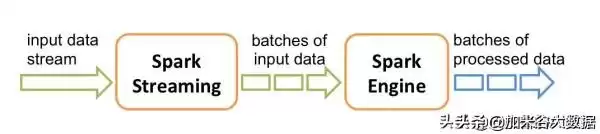

Spark Streaming数据流示意图

Spark是批处理王者,Spark Streaming基于mini-batch思想拆分数据流,实现流处理,形成批流一体框架。

Flink

Flink起源于德国学术项目,2014年成为Apache顶级项目。它主攻流处理,是领域新星。相比前代框架如Storm和Spark Streaming,Flink特性更优。

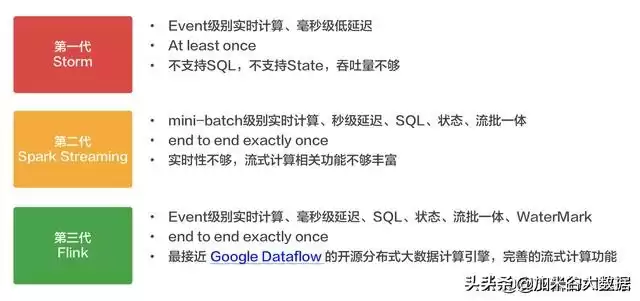

流处理框架演进史

第一代Storm吞吐和延迟较差,且只支持“至少一次”或“至多一次”投递,准确性有限。第二代Spark Streaming用mini-batch近实时处理,但有延迟,优势是批流一体易迁移。Flink是新一代引擎,支持有状态计算,以事件为单位,具备SQL、State等特性,保证“恰好一次”投递,数据更准、吞吐更高、延迟更低、资源更省。

数据皆以流形式产生,批处理是有界数据流的特例。Flink基于此思想,发展成批流一体框架。

Flink的API已完善,支持Java、Scala、Python和SQL,其Scala API与Spark相似,有经验者能快速上手。与Spark类似,Flink专注计算,与Hadoop生态集成。两者竞争学习,未来谁主沉浮,值得期待。

小结

大数据基于分而治之思想,分布式处理计算。历经发展,生态圈涌现众多组件和框架,封装底层技术,提供易用API。Hadoop生态成熟,涵盖基础服务;Spark和Flink专注计算,分别在批处理和流处理领域建立优势。

现在,你已经掌握大数据核心!是时候行动了——尝试用Hadoop或Spark处理你的数据项目,或分享本文给伙伴,一起探索数据世界。评论区告诉我们:你最想用大数据技术解决什么难题?

相关问答

大数据处理的基本流程?

大数据处理第一步是数据抽取与集成。从多样来源提取数据,整理关系与实体,经过清洗转换,为分析奠定基础。

excel大数据处理技巧?

在Excel中处理大数据时,活用筛选排序快速过滤,利用数据透视表汇总分析,结合公式与条件格式提升效率与准确性。

如何对收集到的大量数据进行分析和处理呢?申请方

具体步骤因场景而异,但通用流程包括:可视化分析探索趋势,数据挖掘发现模式,机器学习预测未来,实时处理应对变化。

“大数据”处理技术给人类带来了哪些好处?在线等。急?

大数据技术提升决策能力、优化运营效率、驱动创新产品,从医疗健康到智慧城市,带来前所未有的洞察与价值。

人工智能是如何处理大数据的?

AI通过数据挖掘提取信息,机器学习建模分析,深度学习处理复杂模式,高效利用海量数据,实现智能决策与预测。

大数据技术处理的数据必须具有什么性?

大数据必须具备可扩展性与可处理性,以应对不断增长的规模与复杂性,确保系统能高效存储、计算与分析。

大数据处理的“1秒定律”是什么?_作业帮

“1秒定律”指处理速度需达秒级响应,尤其在实时场景如金融交易或在线推荐,快速处理才能捕获即时价值。

大数据处理包括哪四项任务?

四大任务:数据清洗去噪提质,数据转换整合格式,数据分析挖掘洞察,数据可视化呈现结果。

大数据处理选intel还是amd?

选择多核心多线程CPU,Intel在高端领域表现稳定,但AMD近年崛起,需根据具体负载与预算权衡性能。

数据处理的基本过程是哪四个

基本过程为:收集数据从源头获取,存储数据于可靠系统,处理数据用算法分析,应用数据驱动行动决策。