关键技术详解|腾讯一念 LLM 分布式推理优化实践

作者 | 袁镱

编辑|李忠良

策划|AICon 全球人工智能开发与应用大会

你是否好奇,为什么大模型推理框架在短短半年内性能飙升数倍?从 vLLM、SGLang 到 TensorRT-LLM、MindIE,再到腾讯自研的“一念”,各团队在算子优化、显存管理与调度策略上展开激烈博弈。现有开源框架是否已成熟?推理系统究竟卡在哪些瓶颈?

InfoQ 特邀腾讯 PCG 机器学习平台技术负责人袁镱,在 AICon 全球人工智能开发与应用大会·深圳站分享《一念 LLM 分布式推理优化实践》。从 KV cache 全链路管理、算子自研封装,到多维并行(PP/DP/EP)、MoE 负载均衡与 MLA,以及 PD 分离与多阶段流水线调度,揭秘一套高效工程化解法。

12 月 19~20 日的 AICon 北京站将聚焦大模型训练与推理、AI Agent、研发新范式与组织革新,邀您共同探讨如何构建可信赖、可规模化、可商业化的 Agentic 操作系统,让 AI 成为企业增长核心引擎。

详细日程见:

https://aicon.infoq.cn/202512/beijing/schedule

以下是演讲实录(经 InfoQ 进行不改变原意的编辑整理)。

面对 vLLM、SGLang 等成熟框架,腾讯为何还要自研“一念 LLM”?答案藏在大模型推理的深层挑战中。

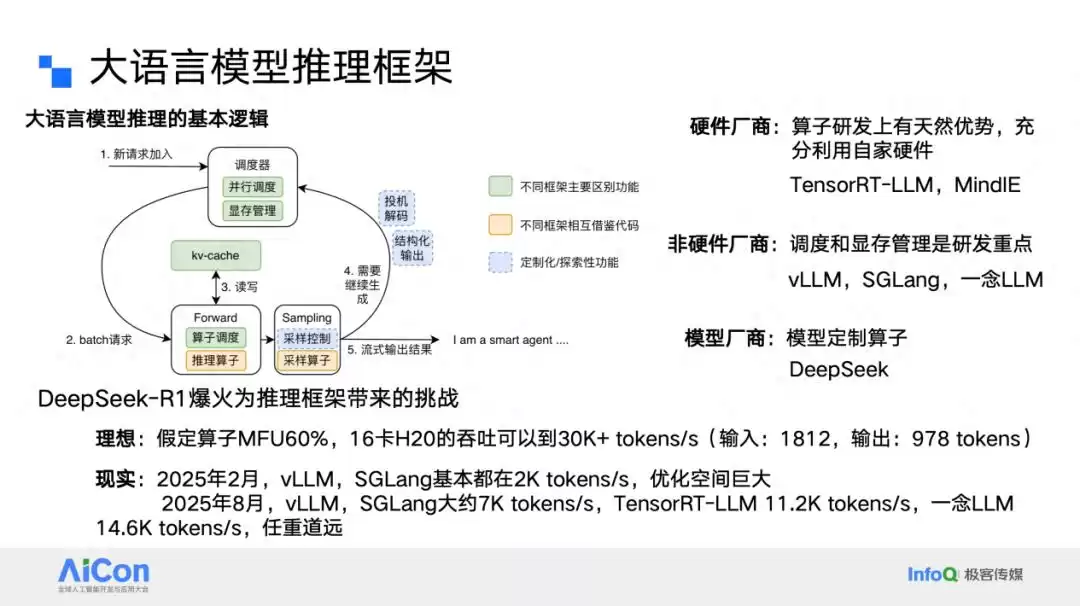

大语言模型推理流程如何优化?当海量请求并发涌入,系统首先进行并行调度与显存管理。KV cache 分配成为关键:显存不足时,需智能决策是从外部调入,还是将请求 offload 到内存。随后,批处理与算子调度生成 KV cache,执行后进入采样阶段。整个过程涉及并行调度、显存队列管理与算子优化,这正是各框架的核心差异点。

算子层面,因 Transformer 架构稳定,优化路径趋同,优秀算子往往被快速复用。硬件厂商如 TensorRT-LLM 凭借硬件理解深度领先;非硬件厂商则聚焦调度与显存管理,如 vLLM 的 paged attention 和 SGLang 的 prefix caching。一念框架在此基础上,针对业务响应与系统稳定性进行深度定制。

竞争为何如此激烈?以 DeepSeek 模型为例,在 H20 16 张卡部署中,理论吞吐应达 30K,但半年前 vLLM 和 SGLang 仅实现 2K。经过优化,当前性能提升至 4-6K,TensorRT-LLM 达 11.2K,而一念则突破至 14.6K。与理论值相比,基础设施仍有巨大优化空间。

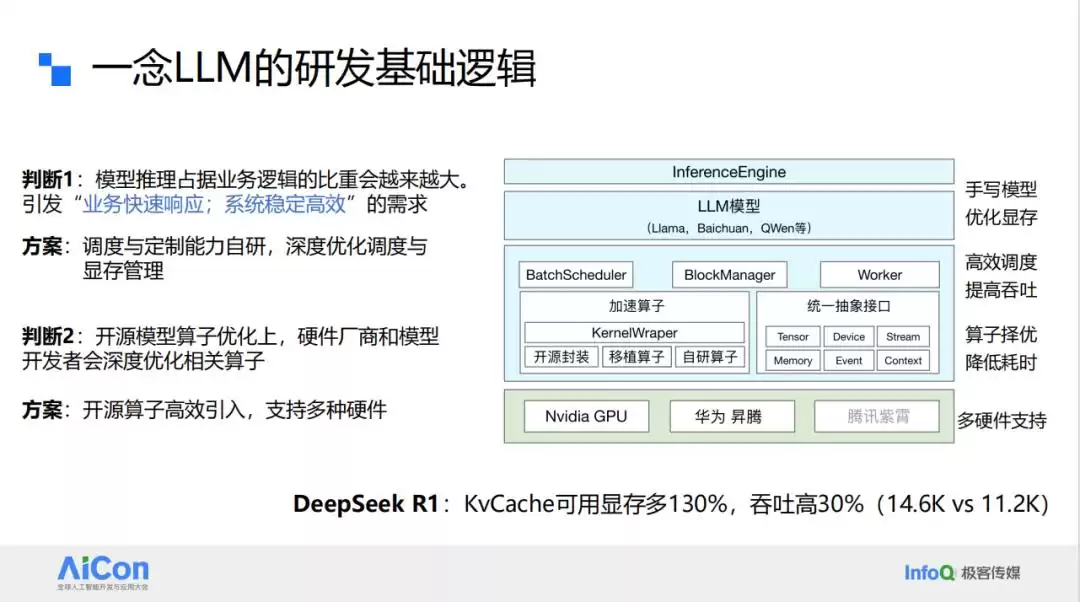

一念框架的设计逻辑基于两大判断:推理环节在业务中占比将持续扩大,成为后台最庞大服务,对可控性与稳定性要求极高;硬件与模型厂商已深度优化算子,一念以高效引入开源算子、支持多硬件为基础,构建 C++ 手写模型架构,实现显存全流程自主管理。在 R1 模型上,Kv-cache 可用显存提升 130%,吞吐量增加 30%。

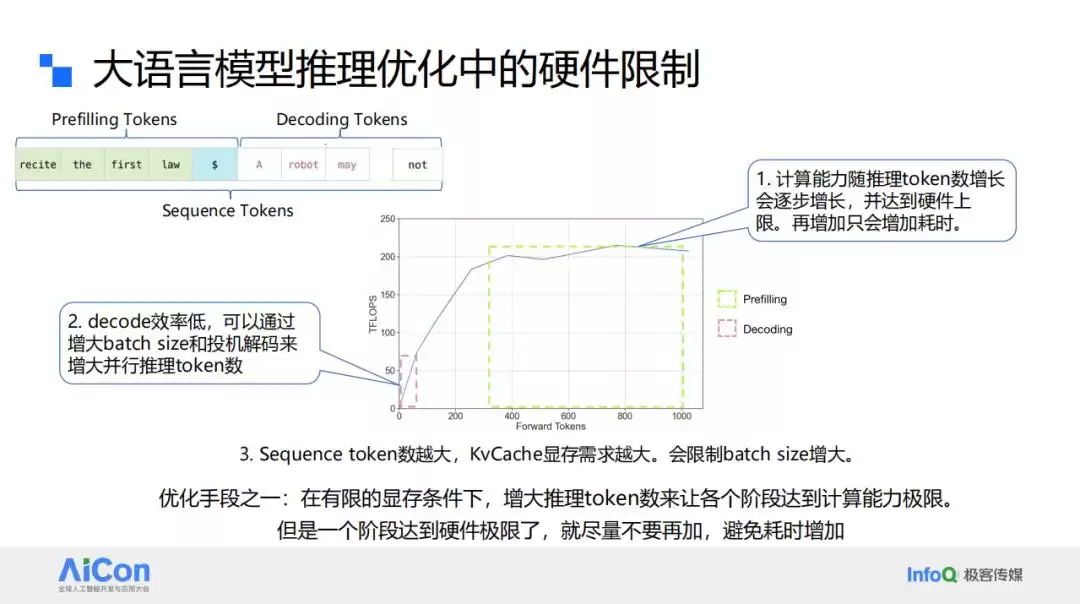

推理优化面临哪些核心瓶颈?Prefilling Tokens 长度增加,但效率低下集中在 Decoding 阶段。每次仅生成 1-3 个 Token,提升 batch size 是直接手段,却受限于显存容量。在 A100 上,Forwarding 计算随 Token 增加逼近硬件上限,而 decoding 的低效需通过并行处理突破。

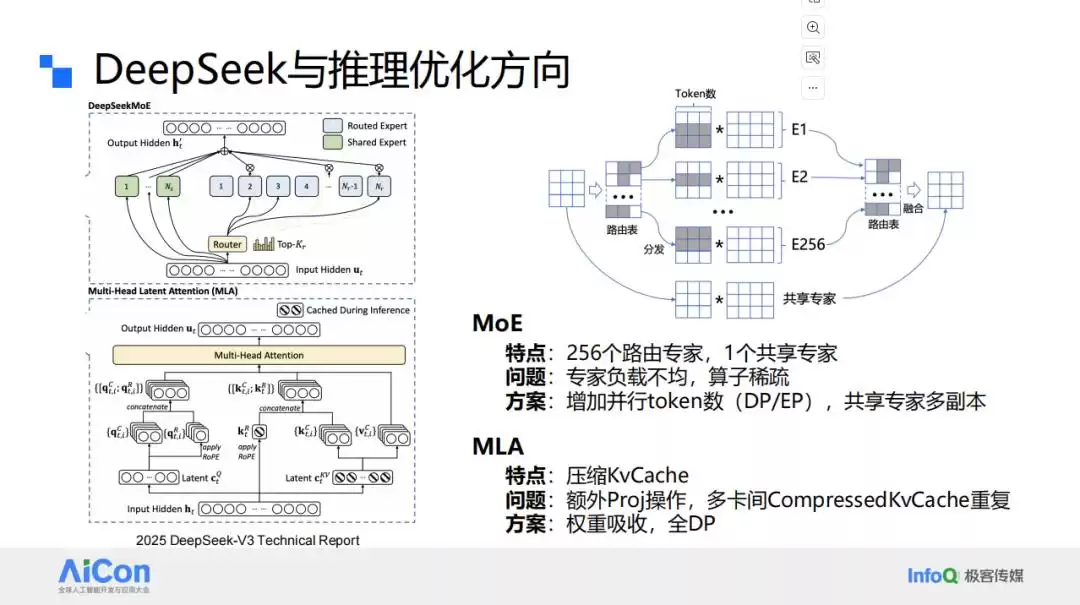

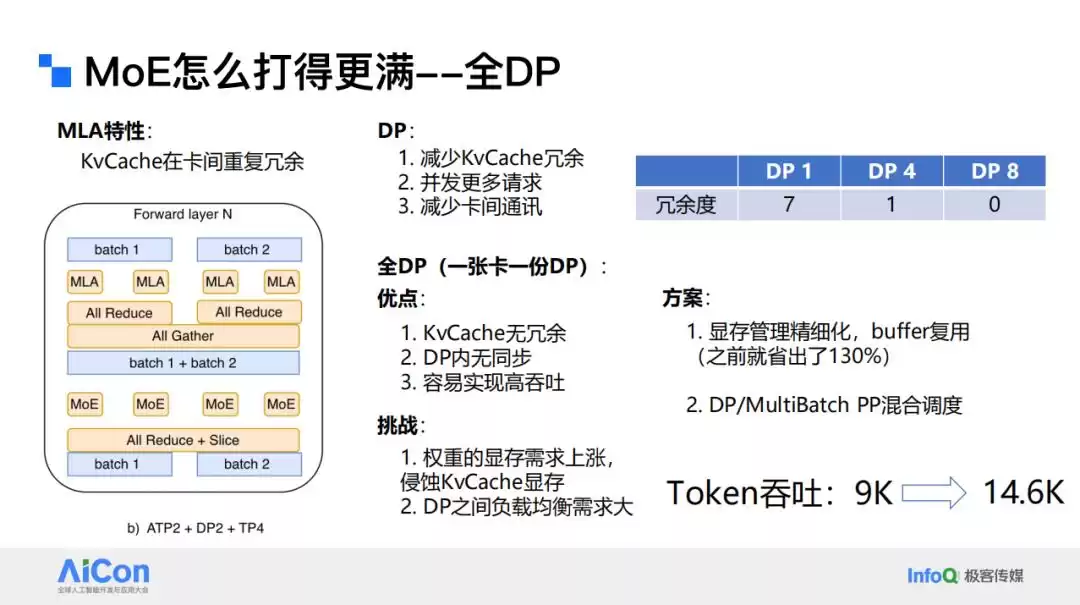

MoE 架构中,256 个路由专家加 1 个共享专家导致负载不均。共享专家路径全量 Token 通过,负载集中。解决方案包括增加并行 Token 数摊薄不均衡,或采用 EP 为共享专家设置多副本。MLA 部分通过压缩 Kv-cache 减少占用,但多卡间重复存储造成浪费,需权重吸收与全 DP 优化。

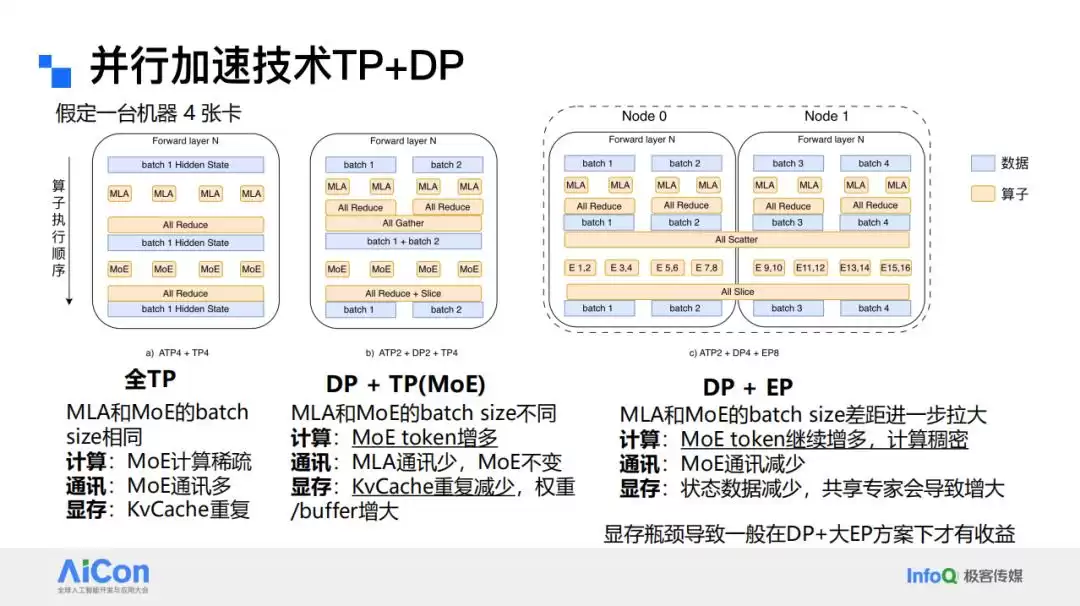

优化技术从计算、通信和显存三维展开。全 TP 方案简单但通信开销大、Kv-cache 冗余。改进方案通过减少冗余,将 MoE 分配到更少卡上,逻辑上扩大 batch 规模,提升 MoE Token 数并降低通信。但 DP 规模过大会增加权重与 buffer 压力,需精细显存管理。

引入 PD 分离(Prefill 与 Decode 分离),因混合执行相互影响性能。Prefill 一次性输入数千 Token 占满硬件,放大 Decode 延迟。DeepSeek 的权重吸收机制进一步增加开销。二者最优 batch size 不同:Prefill 需较小 batch,Decode 需更大 batch。但 PD 分离需 Kv-cache 同步与大并行规模,适合高性能集群,建议依赖云厂商方案。

推理系统为何趋向“小型机化”?同步请求与大量数据交换推动此趋势。例如,61 层 DeepSeek 输出一个 Token 需 122 次跨机通信,性能不足则效率骤降。

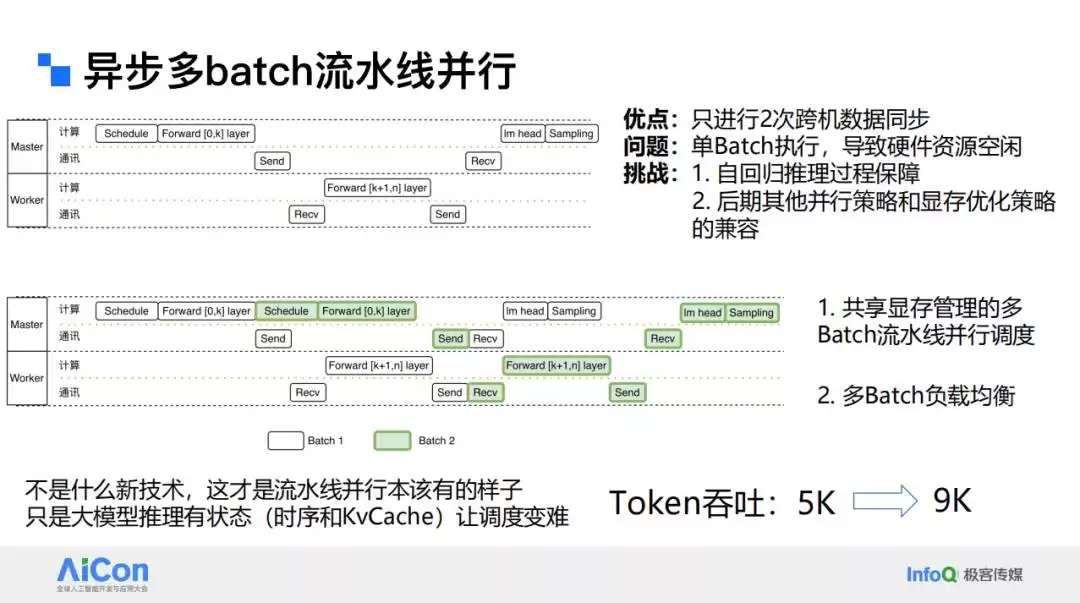

减少跨机通信,流水线并行成关键。两机仅需两次异步通信,大幅降低开销。但 Kv-cache 与自回归逻辑使多 batch 推理复杂。一念实现多阶段流水线并行,通过多 batch 负载均衡优化。Prefill 与 Decode 混合时,调度需引入多种策略,确保性能稳定。优化后吞吐量从 5K 提升至 9K。

提升 MoE 利用率,需解决 DP 中 KvCache 冗余问题。仅保留一份副本避免存储浪费,但权重集中增加单卡压力。面对 64K 请求,需保证任意 DP 可处理,中间 buffer 要求严格。多 DP 细切时,大规模请求放大 MoE 压力,需负载均衡机制。一念通过精细显存管理与 DP 间调度,结合 MT-Batch 与流水线并行,吞吐量达 14.6K。但对比 TensorRT-LLM 的 DP 性能,一念仍有优化空间。

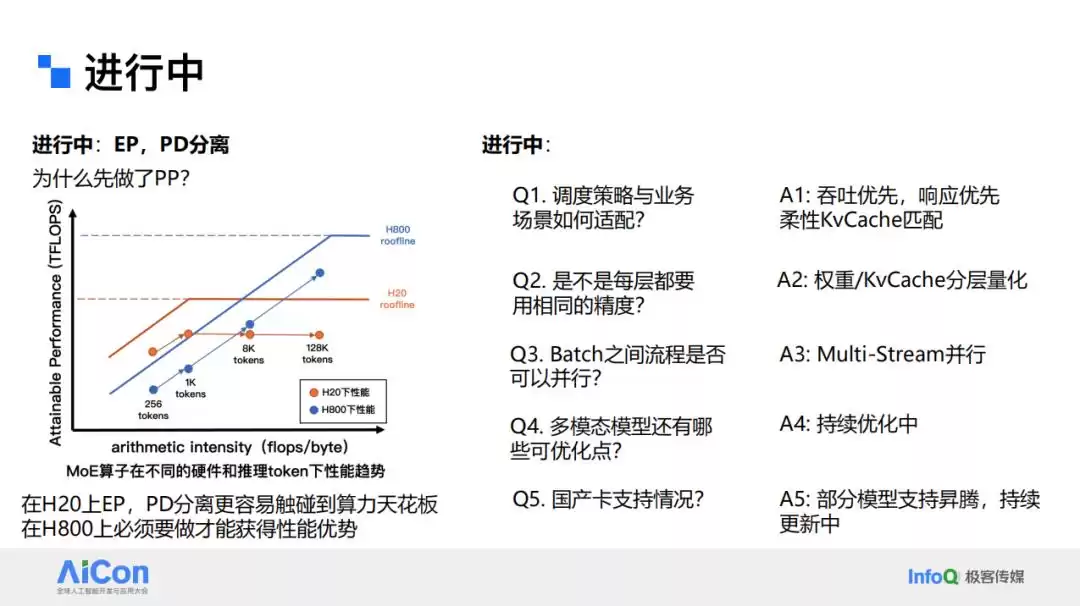

一念优先实现 PP(流水线并行),因硬件性能差异显著。H800 与 H20 存在十倍差距,PP 带来更优显存利用与更低通信开销。EP 与 PD 分离可支持更大 batch size,是下一步重点。当前工作聚焦四大方向:调度策略兼容业务峰值,保证吞吐同时优化 TPOT、TTFT 体验;推进柔性 KV cache,在上下文相似时复用缓存;解耦层间进度,引入异步提升效率;优化 batch 间流程编排,交叉执行提升资源利用率。多模态支持与国产 GPU 适配同步进行。

AI 重塑组织的浪潮已至!12 月 19-20 日,AICon 北京站邀您直面行业变革,探索大模型推理前沿技术。立即报名,与专家共话 Agentic 未来!

相关问答

Java分布式技术学习指南-ZOL问答

分布式事务这块有点难,可以看看Seata框架,了解下常见的解决方案比如TCC、Saga模式学Java分布式的话,先从SpringCloud和Dubbo入手吧,网上教程多,文档也全,上手...

分布式数据融合用的什么技术?

分布式数据融合用的是计算机对按时序获得的若干观测信息,在一定准则下加以自动分析、综合,以完成所需的决策和评估任务而进行的信息处理技术。分布式数据融合...

分布式发电与智能微电网技术就业怎么样?

就业好。前景不错,分析如下:本专业培养德、智、体、美全面发展,具有良好职业道德和人文素养,掌握太阳能、风能、生物质能等多种分布式能源发电基本知识,具...

分布式WiFi是什么技术?-ZOL问答

无线分布式系统WDS(WirelessDistributionSystem),是建构在HFSS或DSSS底下,可让...技术上讲,它是通过Wi-FiMesh系统实现的,在多个接入点之间建立动态路由...

分布式的网络系统采用什么技术?

分布式系统是一个硬件或软件组件分布在不同的网络计算机上,彼此之间仅仅通过消息传递进行通信和协调的系统。1、副本(Replica)是分布式系统最常见的概念之一...

分布式电源接入电网技术规范?

根据《国家电网公司光伏电站接入电网技术规定》4.3.1要求:小型光伏电站总容量不宜超过上一级变压器供电区域内最大负荷的25%。当地相关执行依据为电力行业标...

云计算分布式技术的五大特点?

云计算分布式技术具有以下五大特点:1.资源共享:云计算分布式技术允许多个用户共享同一组资源,包括计算资源、存储资源和网络资源。这样可以更有效地利用资源...

分布式发电与微电网专业好不好?

分布式发电与微电网专业是一个涉及电气工程、能源管理和电力系统运行的领域。以下是关于这个专业的一些观点:-就业前景:随着可再生能源的快速发展和分布式...

区块链的分布式账本技术有什么好的应用吗?

日本SBI控股株式会社进军区块链的行动还没有完全结束。这家金融巨头公司日前宣布,计划推出一款将使用Ripple(瑞波币)分布式账本技术的iOS和Android移动支付应...

云计算分布式技术具有廉价性吗?

云计算分布式技术具有廉价性。因为分布式技术通过多副本、分散数据存储等技术,可以让整个服务不受个别硬件不可用的影响。这就意味着云服务可以大量使用廉价...