AI入门第一课:深入浅出,揭开神经网络的神秘面纱

嘿,你是否对AI技术充满好奇,却觉得它高深莫测?别担心,今天我将带你零基础探索神经网络的奥秘!作为产品经理,我坚信掌握前沿技术是关键,因此我以“费曼学习法”为核心,将这些复杂概念通俗化,让你一目了然。

神经网络,灵感源自生物学的大脑与视觉系统。它不仅是人脑的模拟,更是视觉处理的革命。

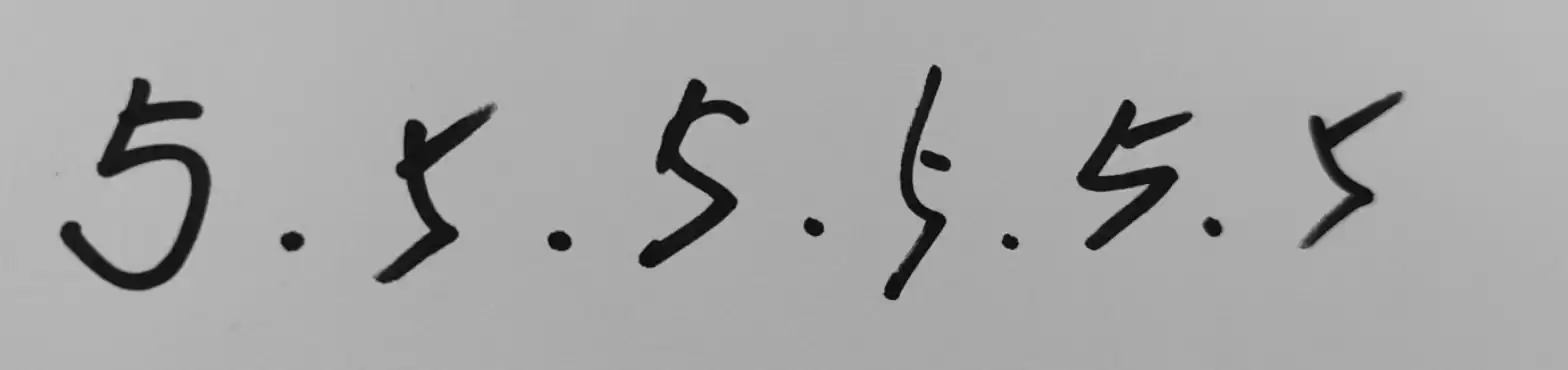

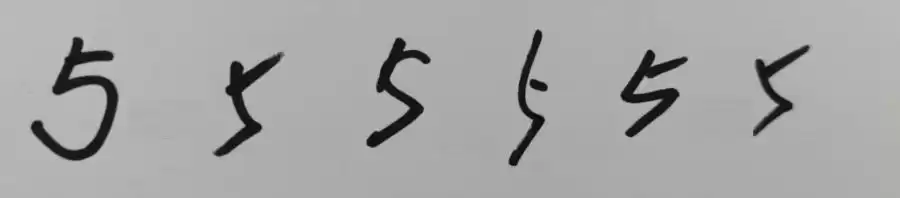

人类视觉极其强大:我们能瞬间识别手写数字,无论字形多古怪。这背后是数亿神经元的协同运作,但计算机却难以企及。

例如,看到数字“5”,人眼捕捉图像,大脑快速解析并输出结果。即使字形扭曲,我们也能联想识别。

计算机没有“视觉神经”,摄像头只能“看”而不会“想”。这时,神经网络登场了!它模拟人类判断,通过计算集群处理图像、语音、语言等复杂任务,这正是AI替代人力的技术基石。

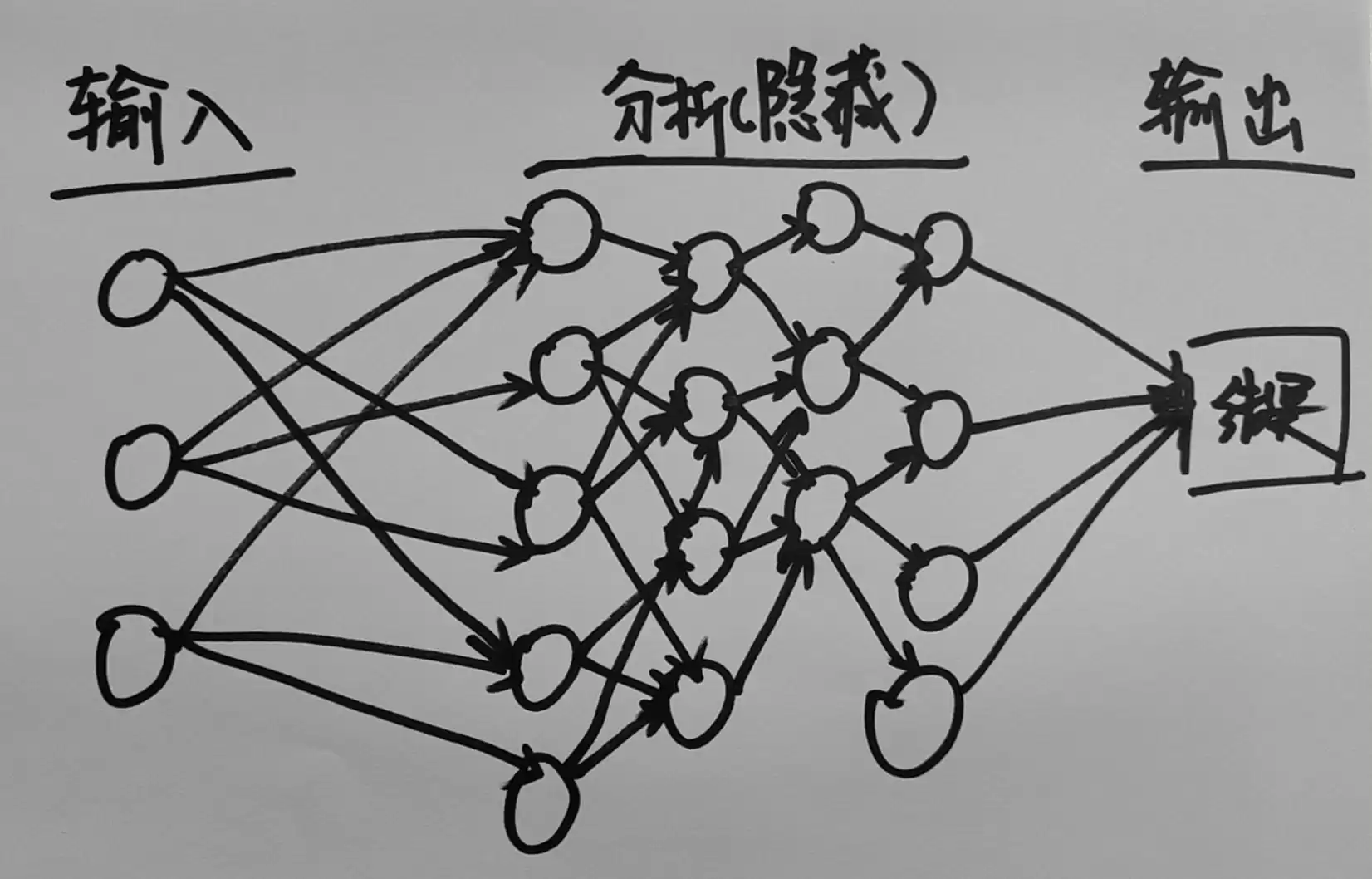

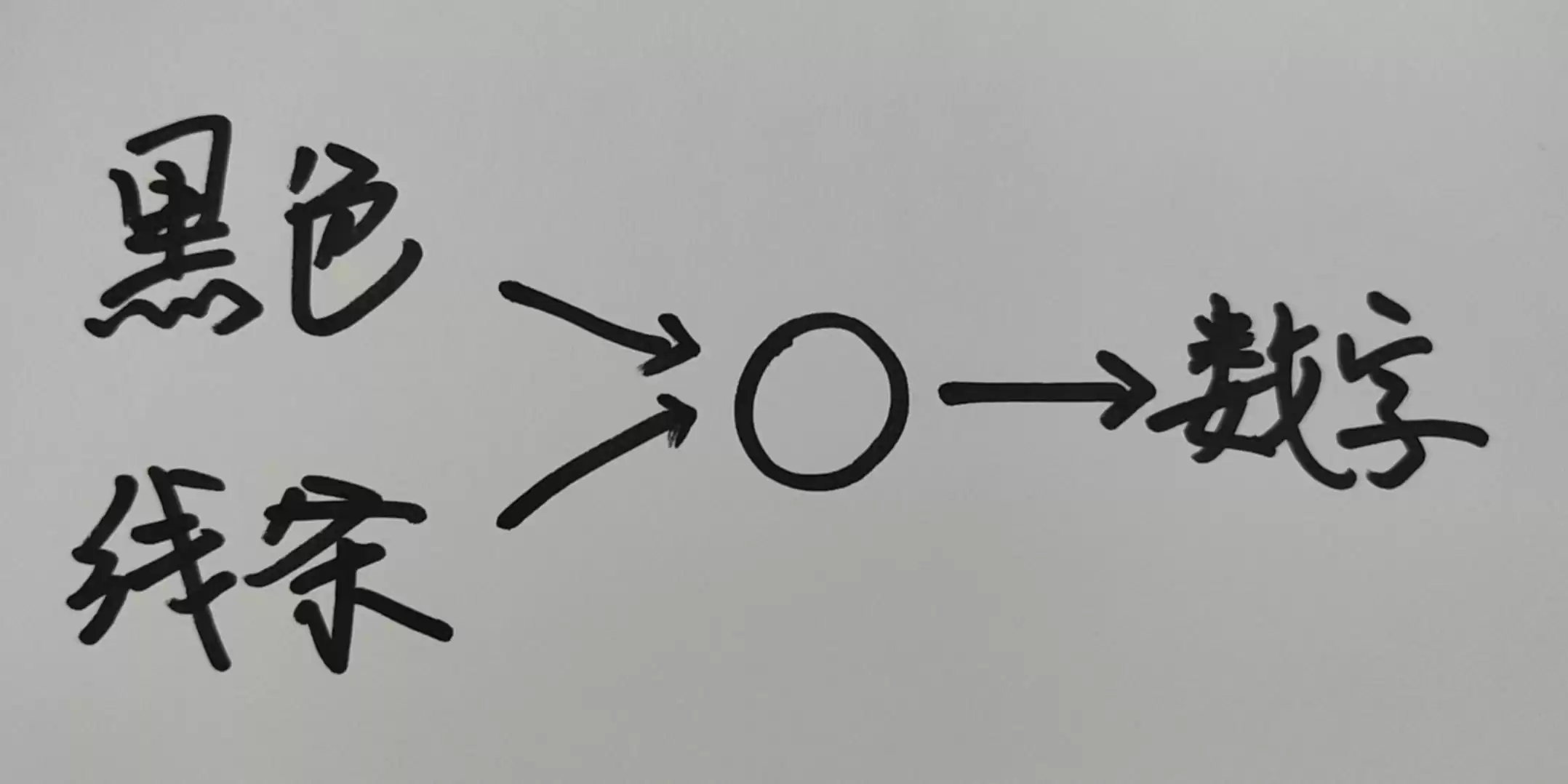

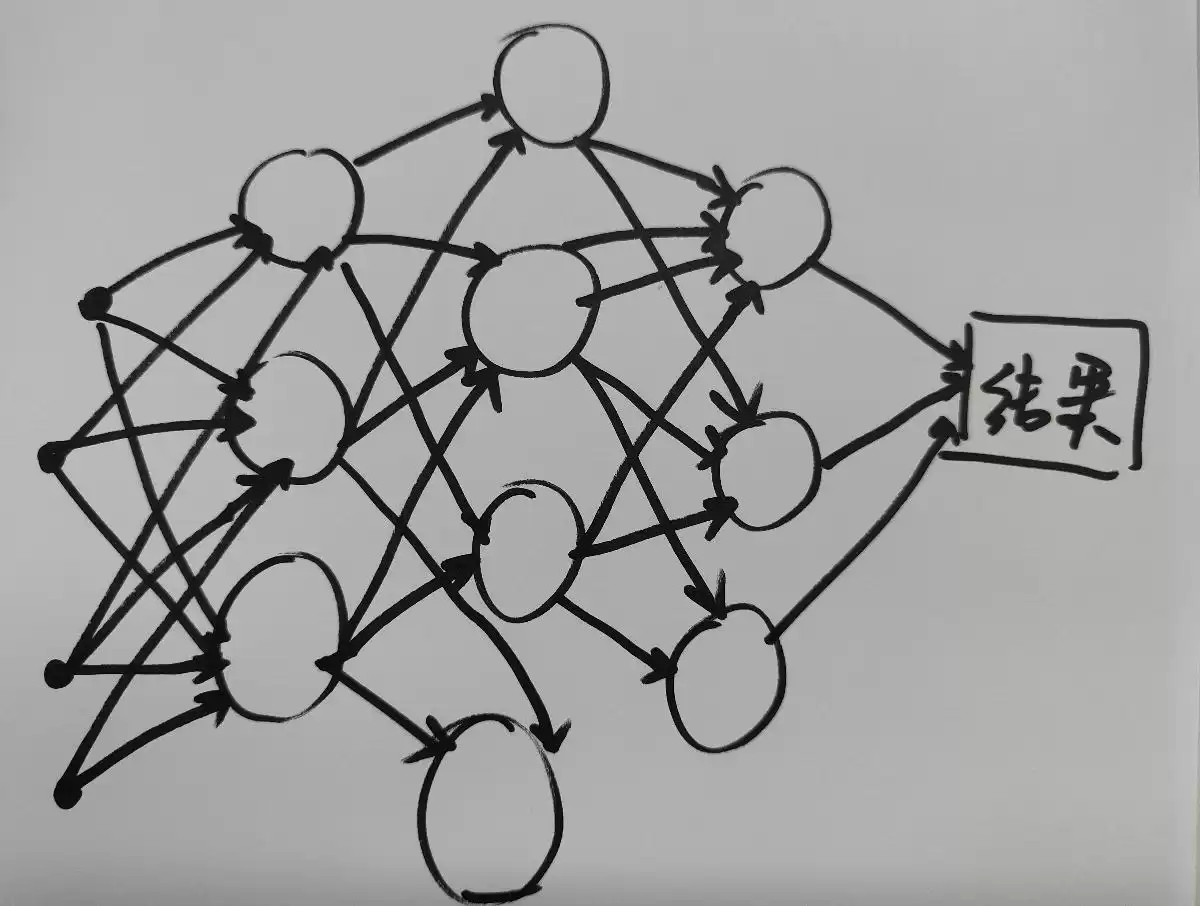

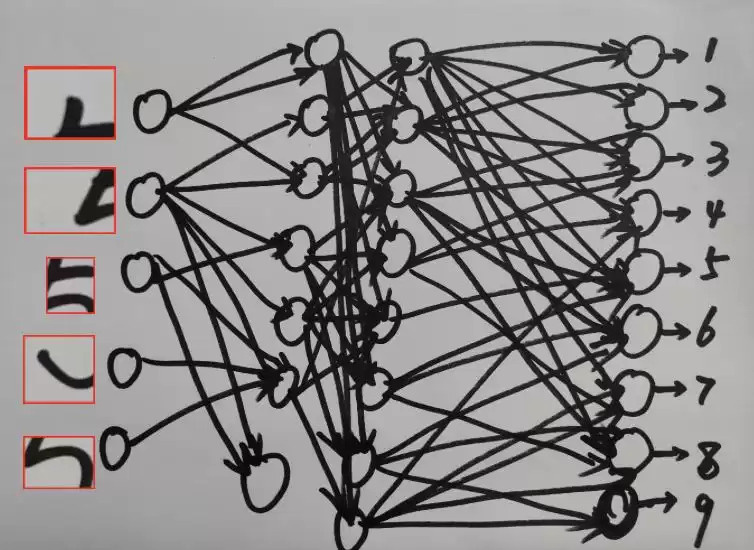

二、神经网络是什么?其中有什么?科学家将判断分为三步:输入-分析-输出。神经网络据此设计,由输入层、隐藏层(分析层)和输出层构成。

人工神经元分布各层,通过函数连接成网,形成智能结构。下面介绍两种核心神经元模型。

1. 感知器

输入层的关键是获取有效信息。感知器赋予计算机“优先级识别”能力,像人眼一样聚焦重点。

以数字图为例,我们会先关注黑色字体“5”,忽略灰色背景。但计算机最初只见混沌。

感知器通过二进制权重和判断,实现智能识别。例如,在图中,“线条”权重大于“黑色”,以区分数字与杂点。

感知器接力运算,瞬间完成海量判断,这也是AI依赖强大算力的原因。注意,每个感知器仅输出单一结果,但可被下层多个感知器复用。

2. S型神经元

感知器有短板:权重微小变化可能导致结果剧变。如何修正?引入“复盘”机制!

S型神经元能自行复盘,通过Sigmoid函数微调权重和偏差,确保输出稳定。这是机器学习的关键——持续修正,逼近最优。

Sigmoid函数连续可微、非线性,支持梯度优化,让网络学习复杂模式。如今,ReLU等高级函数更常用,但S型神经元奠定了基石。

3. 补充信息:前馈神经网络和循环神经网络

前馈神经网络单向流动,从输入到输出,适合图像、视频处理,商用广泛。

循环神经网络则更贴近人脑,允许信息循环,记忆先前输入,擅长序列任务如语音识别。两者各展所长,推动AI多元化发展。

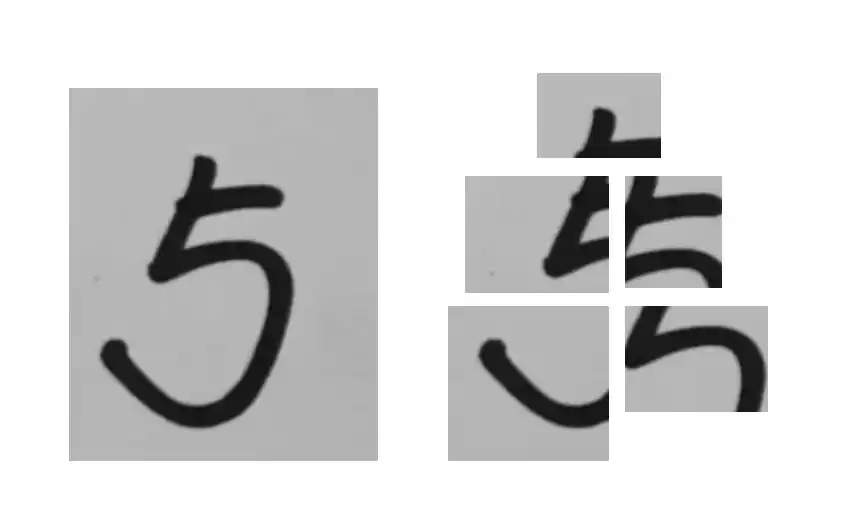

三、实战:利用神经网络分析该数字是5以前文数字5为例,实战解析。

首先识别并提取所有数字。

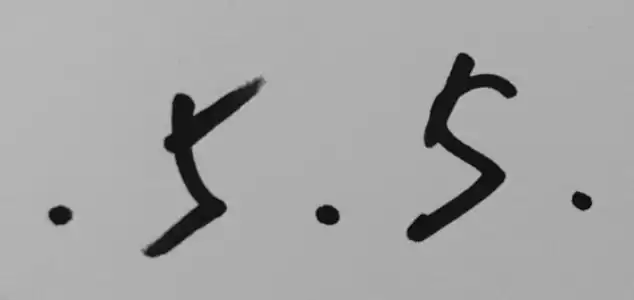

然后分隔数字,并分割数字本身。

碎片化后,每个碎片带权重属性。通过四层网络判断特征,最终输出结果:9个神经元对应数字0-9,激发者即为识别数字。

这只是思维示例,真实网络可灵活设计,展现神经网络的场景适应力。

四、训练神经网络:梯度下降算法网络如何更精准?答案:持续训练!

通过梯度下降算法最小化成本函数,快速调整权重和偏差,即使起点不佳,也能优化性能。它如登山者下山,沿最陡坡度速达谷底。

操作步骤:

初始化参数:随机设置权重和偏差。定义损失函数:如均方误差,量化预测差异。计算梯度:求偏导,找最快下降方向。更新参数:逆梯度调整,降低损失。迭代过程:重复至收敛。学习率调整:动态步长,避免振荡。随机梯度下降:小批量数据提速。监控和调试:确保损失下降,调参优化。

优质数据+简单算法,常胜于复杂模型,可见训练至关重要。

五、总结神经网络将难题拆解为简单子问题,通过多层网络协同解决。深度学习赋予其自学习能力,依托梯度下降快速调优,这才让AI遍地开花。

想亲手搭建神经网络?或探索更多AI战术?关注本系列,解锁实战技巧,一起玩转AI世界!

专栏作家

瑞瑞女士,人人都是产品经理专栏作家。关注人文、心理、传播学,深耕技术与社会文化,擅长内容运营与产品设计。

题图来自 Unsplash,基于 CC0 协议

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

相关问答

谷歌神经网络运用什么技术?

据悉,谷歌的“虚拟大脑”模拟脑细胞交流设计,可通过观看YouTube学习识别物体。当数据输入,神经元交互学习,实现智能突破。

可否借助深度神经网络技术,辨别Deepfakes伪造的照片?

随着Deepfakes伪造技术兴起,AI辨伪成热点。加州大学研究显示,深度网络能通过分析纹理、光影等特征,有效识别伪造图像,为安全护航。