极少数据就能微调大模型?一文彻底拆解LoRA等方法的运作奥秘

Michael Liu 投稿量子位 | 公众号 QbitAI

你是否发现,最近与大模型一同引爆热度的,还有那些堪称“魔法”的微调技术?

它们仅需寥寥数百样本,就能让大模型在下游任务中脱胎换骨,瞬间晋升为领域专家。

而其中最具颠覆性的微调方法,非LoRA莫属——它正以极简参数、超高效率,重新定义模型适配的边界。

但你是否好奇,包括LoRA在内的这些方法,核心原理究竟是什么?它们如何与庞大大模型协同作战?今天,我们就直击本质,揭开其背后的科学面纱。

一、前言:LoRA为何能引爆风潮?

LoRA(低秩适配)在ICLR2022中横空出世,核心思想惊艳四座:通过低秩矩阵分解,只需训练极少量参数,就能让大模型完美适配下游任务。

LoRA具体如何实现微调?

流程极其精妙:仅用下游任务数据训练新增的轻量参数模块,训练完成后,通过重参数化技术将新参数与原模型合并,实现“无感”集成——既达到全参数微调的效果,又丝毫不增加推理耗时。

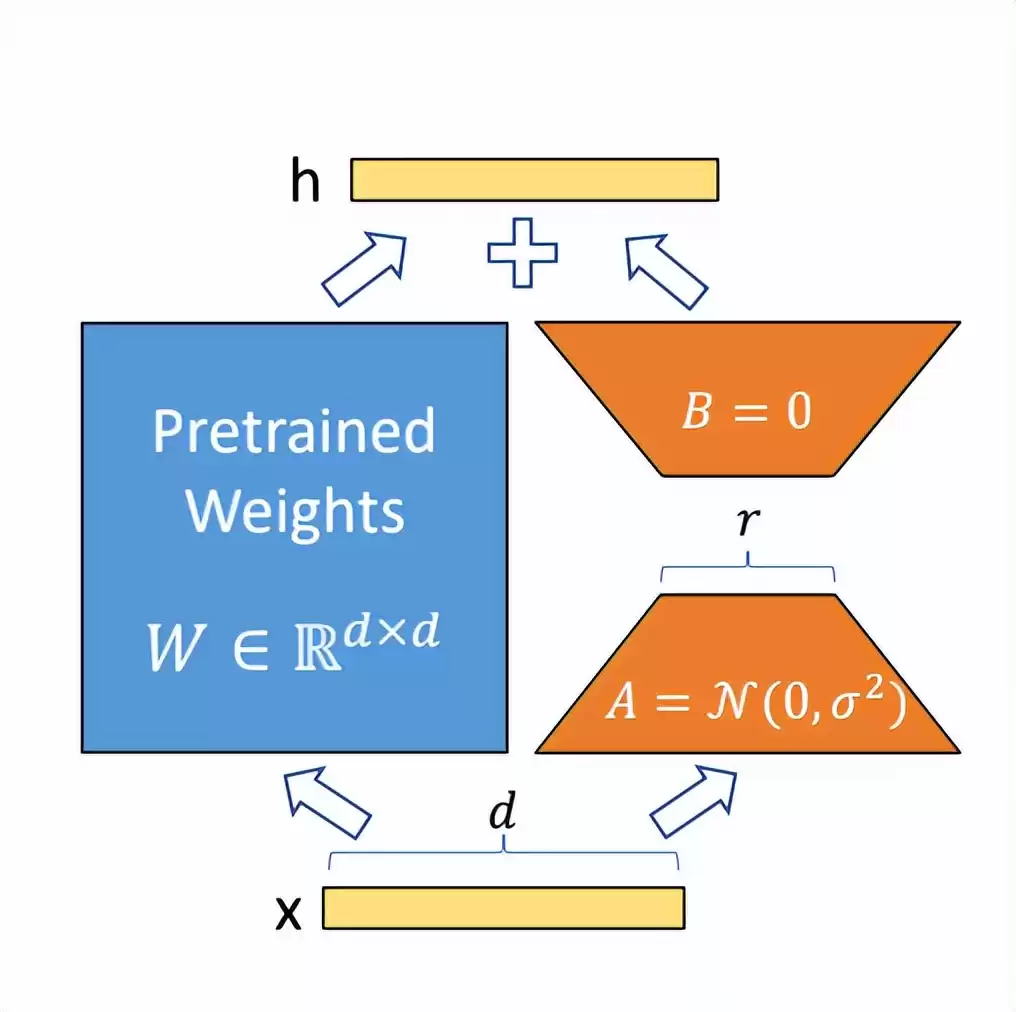

LoRA的工作示意图如下:

图中蓝色部分为预训练好的固定参数,LoRA巧妙旁路添加了A、B两个低秩结构。A、B参数分别初始化为高斯分布和零矩阵,训练伊始附加影响为零。

A的输入与B的输出维度匹配原模型,而A的输出与B的输入维度大幅压缩,正是“低秩”精髓所在(类似残差结构),从而将待训练参数量压至极低。

训练时仅更新A、B;推理时合并入原网络,零额外计算开销。更妙的是,针对不同任务(如文本分类、对话生成),只需在统一预训练模型上重训AB模块即可,极大加速多任务部署节奏。

LoRA原文已通过详实实验验证其卓越性能。但更深层的问题是:为何这般“小修小补”就能奏效?

答案指向一个关键概念:本征维度。这正是LoRA灵感之源,源自以下两篇重磅论文:

1、MEASURING THE INTRINSIC DIMENSION OF OBJECTIVE LANDSCAPES(ICLR2018,下称【论文1】)

2、INTRINSIC DIMENSIONALITY EXPLAINS THE EFFECTIVENESS OF LANGUAGE MODEL FINE-TUNING(ACL2021,下称【论文2】)

二、本征维度:模型优化的隐藏密码本征维度由【论文1】首创,它揭示了神经网络训练中的一个惊人事实:模型参数虽多,但真正需优化的维度可能极少。

回想网络训练三部曲:

1、固定数据集与网络结构,定义损失函数2、随机初始化参数3、迭代优化降低损失

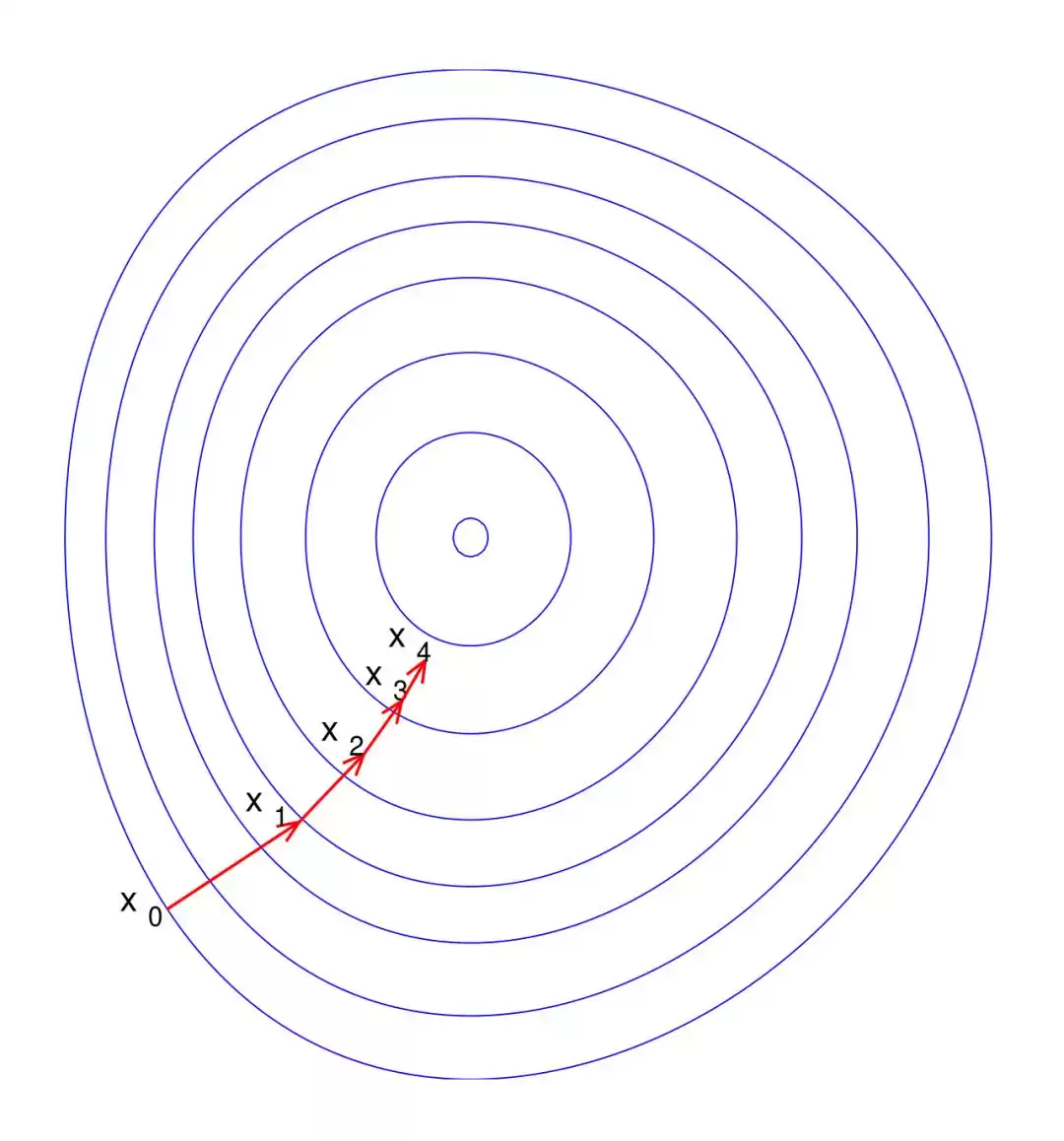

此过程可视为在预设的“目标地形图”上搜寻有效路径。一旦数据与结构确定,地形图即固定。

如下图所示:

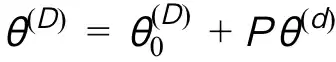

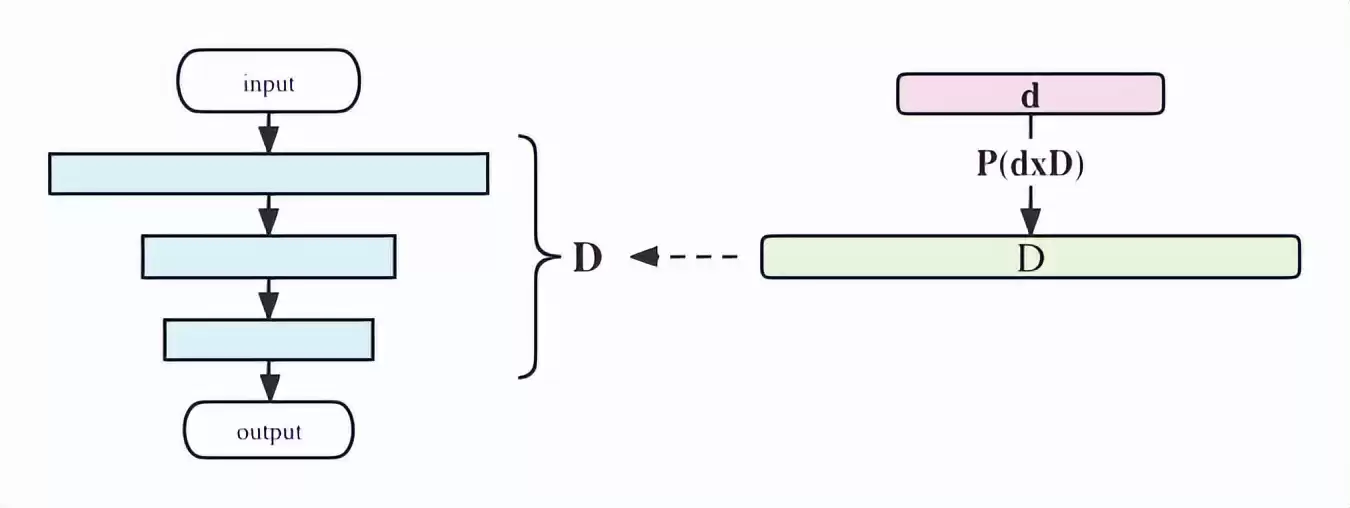

对于一个D维参数模型 ,训练本质是在D维空间寻优。但研究指出,D可能高度冗余,实际仅需优化d个参数即可找到有效解。

,训练本质是在D维空间寻优。但研究指出,D可能高度冗余,实际仅需优化d个参数即可找到有效解。

公式化表达:

其中 为D维参数向量,

为D维参数向量, 为随机初始化且固定的偏置,P为固定随机投影矩阵(D×d),

为随机初始化且固定的偏置,P为固定随机投影矩阵(D×d), 为待优化的d维核心参数。

为待优化的d维核心参数。

换言之,仅优化d维参数就足以让网络发挥出色性能。这个d即为模型的本征维度。

下图直观展示:

蓝、绿部分固定,仅训练红色参数。d即为本征维度。

如何界定“出色性能”?文章定义:当仅优化d维参数能达到全参数训练90%效果时,即认定d为本征维度(记为 )。例如,全参数模型在MNIST分类精度0.9,仅训d维参数达0.81时,d即本征维度。

)。例如,全参数模型在MNIST分类精度0.9,仅训d维参数达0.81时,d即本征维度。

【论文2】将本征维度理论用于解释大模型微调的神奇效率:为何几百样本就能让大模型精准适配?

【论文1】指出,特定任务在目标精度下存在本征特征。对大模型而言,测算其本征维度即可揭示:解决下游任务实际需调整多少参数。

若有实验证实仅调少数参数就能胜任,则微调有效性之谜迎刃而解。下文“文章”均指【论文2】。

3.1 大模型是否存在本征维度?沿用公式 ,但关键升级:

,但关键升级: 采用预训练参数,而非随机初始化。

采用预训练参数,而非随机初始化。

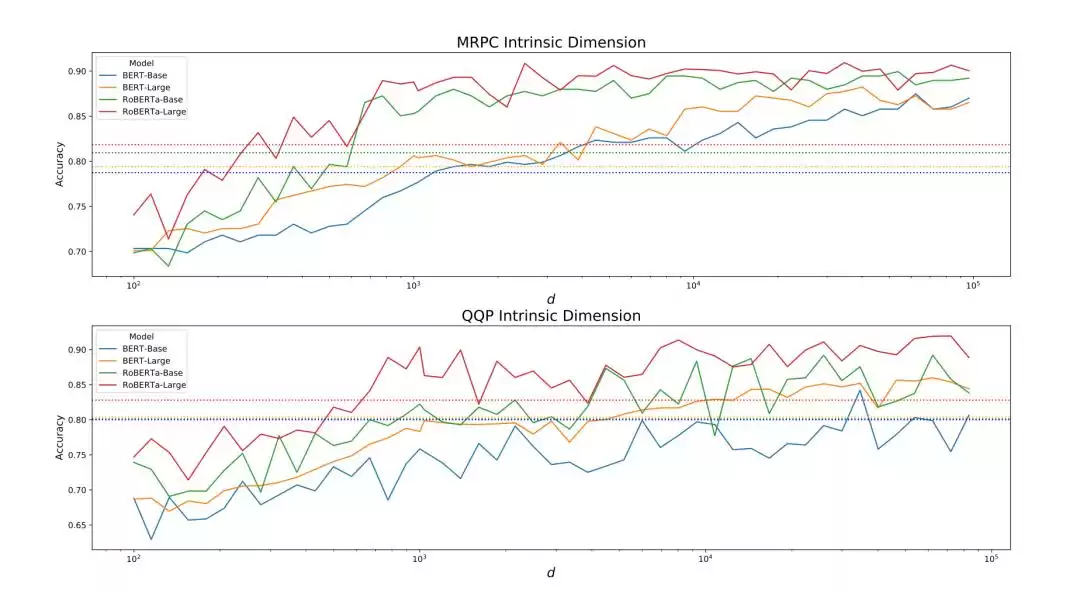

实验选取BERT与RoBERTa的Base/Large版本,在GLUE的MRPC、QQP(句子对语义匹配)任务上测试。

上下子图分别对应MRPC、QQP。实线为各模型准确率,虚线为全参数微调90%基准线。横坐标d维训练大小。清晰可见,两任务四模型仅需极小d维即可逼近90%精度——本征维度在大模型中确凿存在!

这意味着,下游任务微调仅需训练少量参数即可获优异效果。但作者进一步探索,发现了更深刻规律。

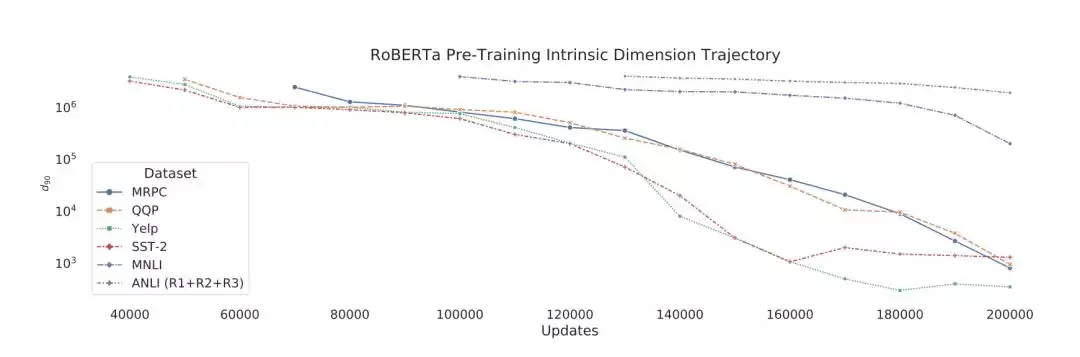

3.2 预训练质量如何影响本征维度?假设:预训练能隐式降低模型在各NLP任务的本征维度。

验证实验:在RoBERTa-base预训练中,每10K步保存模型,随后测算其在MRPC、QQP、Yelp Polarity、SST-2、MNLI、ANLI六个数据集的本征维度。

结果如下:

所有数据集呈现一致趋势:预训练步数增加,本征维度持续下降。无需特意优化,仅延长预训练即可强化表征、压缩本征维度。

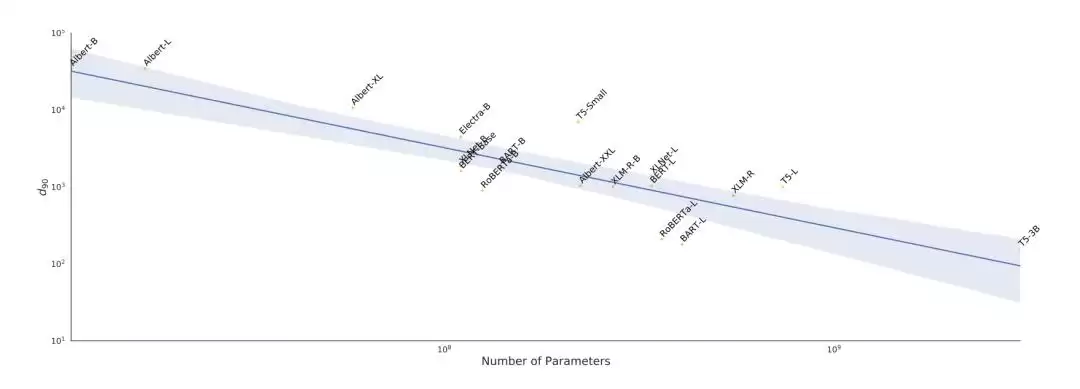

3.3 模型规模与本征维度有何关联?理想需统一结构,但为效率,文章基于已有预训练模型在MRPC上测算。

实验结果:

纵坐标本征维度值,横坐标参数量。明显趋势:模型越大,本征维度越小——越强大的模型,其内在优化维度越精简。

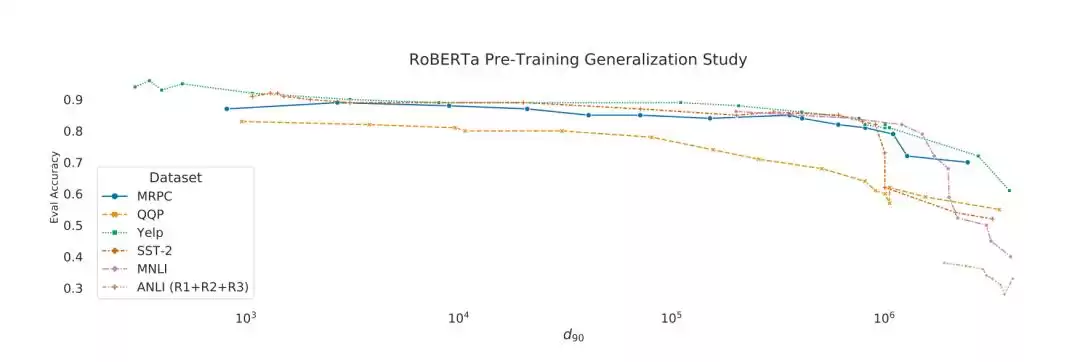

3.4 本征维度如何决定泛化能力?核心问题:本征维度小,是否意味着泛化能力强?

实验将3.2中保存模型,在对应 本征维度下,跨数据集测试泛化性能。

本征维度下,跨数据集测试泛化性能。

结论确凿:本征维度越低,训练所得模型准确率越高——即本征维度与泛化性能强负相关。

回到最初之问:为何LoRA能成?

正因为大模型普遍存在低本征维度,仅需调整微量参数即可高效适配下游任务。LoRA正是这一原理的绝佳工程实现。

参考文献:[1]https://en.wikipedia.org/wiki/Gradient_descent[2]https://arxiv.org/pdf/1804.08838.pdf[3]https://arxiv.org/pdf/2012.13255.pdf[4]https://arxiv.org/pdf/2106.09685.pdf

原博客地址:https://michaelliudev.blog.csdn.net/article/details/131745794

— 完 —

量子位 QbitAI · 头条号签约

关注我们,第一时间获知前沿科技动态

相关问答

lora网关原理?

LoRa网关是网络中枢,采用星型或网状拓扑,通过转发节点信息大幅扩展通信距离与覆盖规模。代价是复杂度提升,可能影响传输效率。

lora模型训练原理?

LoRa模型训练运用机器学习算法处理设备数据,优化性能预测。流程包括:1. 大规模数据收集与清洗;2. 特征工程与模型架构设计;3. 低秩适配训练与评估迭代。

lora与lora之间的通信原理?

LoRa通信基于扩频技术,终端节点在许可频段跳频传输,通过网状中继增强距离与规模。但这会引入延迟与功耗权衡。

lora组网中智能网关模块的原理?

智能网关模块整合协议栈与边缘计算,动态管理节点接入、数据聚合与安全路由,实现自适应网络调度与负载均衡。

Lora模型是什么?如何使用及特点介绍-ZOL问答

LoRA模型是一种高效微调技术,可视为大模型的“轻量插件”。使用时安装对应库,加载LoRA模块至基座模型,即可用少量数据快速专精化。特点:参数高效、训练快捷、无损合并。

如何构建具有长期记忆和高效陪伴能力的AIAgent?-ZOL问答

构建此类Agent需融合长效记忆存储、情境检索与情感计算模块。当前GPT等API更像强化提示词库,代理核心问题如自主决策、长期一致性仍待突破。

物联网工程师需要掌握哪些核心技能?-ZOL问答

物联网工程师需精通终端硬件(传感器/MCU)、无线协议(如LoRa/NB-IoT)、云平台集成、数据安全及边缘AI算法,实现端到端系统设计与优化。

空调的四种方式是什么-ZOL问答

空调基础模式涵盖制冷、除湿、送风、制热。部分机型增设自动或睡眠模式。滤网原理类似空气净化器,确保循环空气清新。